二、更强企业级AI系统,全球最快AI超算

二、更强企业级AI系统,全球最快AI超算

基于A100,英伟达最先进的企业级AI基础设施DGX H100系统、DGX POD、DGX SuperPOD以及一一登场。它们将从今年第三季度开始供应。

黄仁勋称,在财富10强企业和100强企业中,分别有8家和44家企业使用DGX作为AI基础架构。

英伟达DGX系统现在包含英伟达AI Enterprise软件套件,该套件新增了对裸金属基础设施的支持。DGX客户可使用软件套件中的预训练AI平台模型、工具包和框架来加快工作速度。

1. DGX H100:最先进的企业级AI基础设施

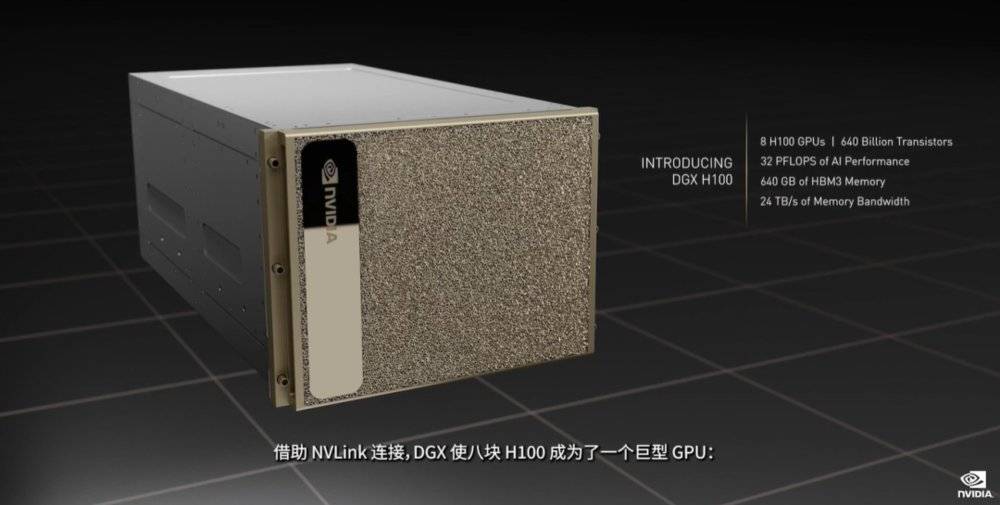

第四代英伟达DGX系统DGX H100是一款基于英伟达H100 Tensor Core GPU的AI平台。

每个DGX H100系统配备8块H100 GPU,总计有6400亿个晶体管,由NVLink连接,在全新的FP8精度下AI性能可达32Petaflops,比上一代系统性能高6倍。

DGX H100系统中每块GPU都通过第四代 NVLink连接,可提供900GB/s的带宽,是上一代系统的1.5倍。DGX H100的显存带宽可达24TB/s。

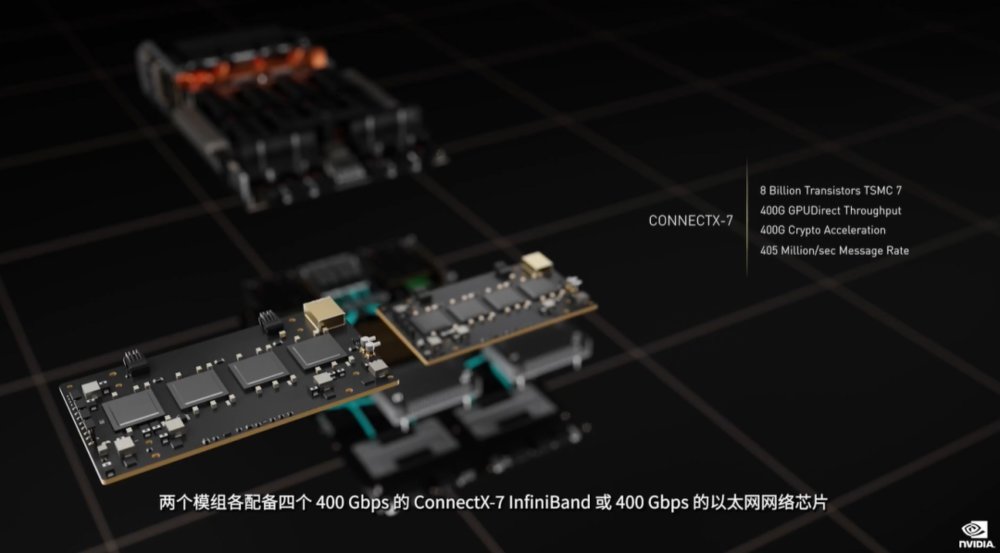

该系统支持双x86 CPU,每个系统还包含2个英伟达BlueField-3 DPU,用于卸载、加速和隔离高级网络、存储及安全服务。

8个英伟达ConnectX-7 Quantum-2 InfiniBand网卡能够提供400GB/s的吞吐量,可用于连接计算和存储,这一速度比上一代系统提升了1倍。

2. DGX SuperPOD:FP8 AI性能达1Exaflops

DGX H100系统是新一代英伟达DGX POD和DGX SuperPOD超级计算机的构建模块。

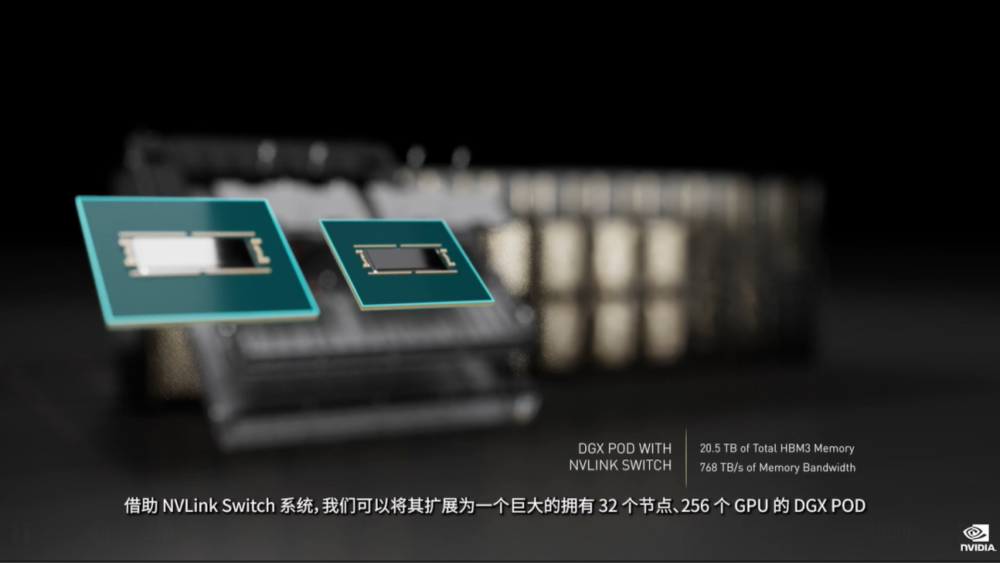

借助NVLink Switch系统,拥有32个节点、256个GPU的DGX Pod,其HBM3显存达20.5TB,显存带宽高达768TB/s。

“相比之下,整个互联网不过只有100TB/s。”黄仁勋感慨道。每个DGX都可借助4端口光学收发器连接到NVLink Switch,每个端口都有8个100G-PAM4通道,每秒能够传输100GB,32个NVLink收发器连接到1个机架单元的NVLink Switch系统。

新一代DGX SuperPOD可提供1Exaflops的FP8 AI性能,比上一代产品性能高6倍,能够运行具有数万亿参数的大型语言模型工作负载;还有20TB的HBM3显存、192TFLOPS的SHARP网络计算性能。

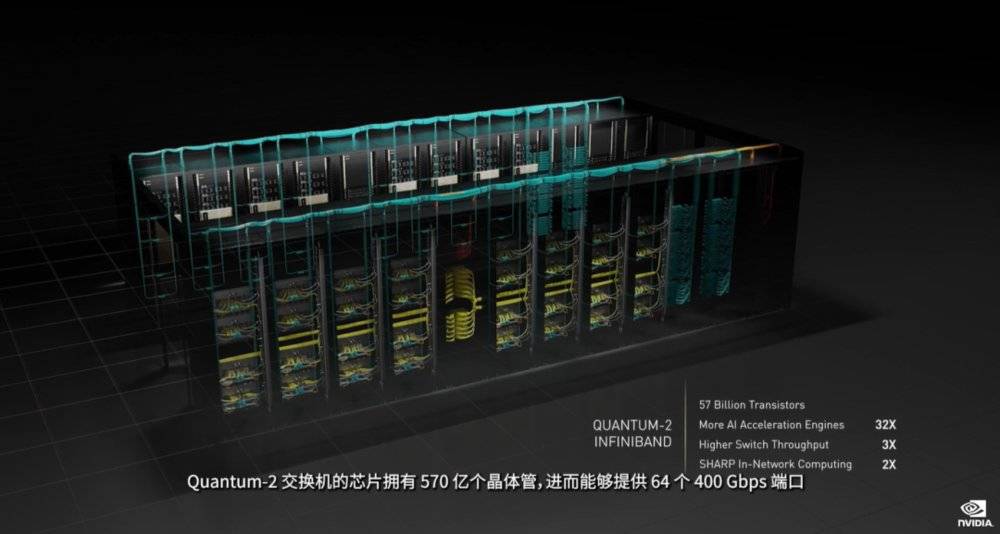

通过采用Quantum-2 InfiniBand连接及NVLink Switch系统,新DGX SuperPOD架构在GPU之间移动数据的带宽高达70TB/s,比上一代高11倍。

Quantum-2 InfiniBand交换机芯片拥有570亿个晶体管,能提供64个400Gbps端口。多个DGX SuperPOD单元可组合使用。

此外,英伟达推出新的DGX-Ready托管服务计划,以助力简化AI部署。其DGX Foundry托管的开发解决方案正在全球扩展,北美、欧洲和亚洲的新增地点支持远程访问DGX SuperPOD。

DGX Foundry中包含英伟达Base Command软件,该软件能够使客户基于DGX SuperPOD基础设施,轻松管理端到端AI开发生命周期。

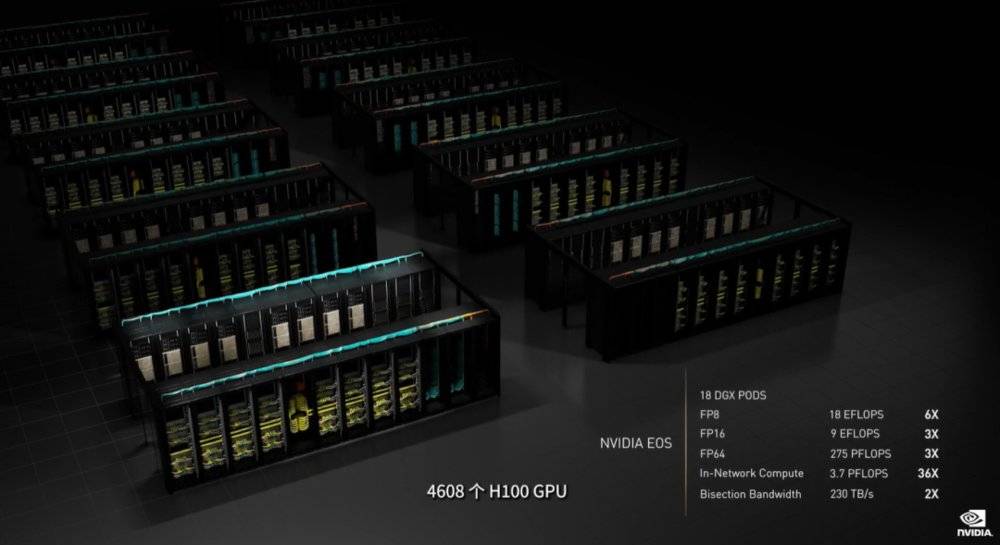

3. Eos:全球运行速度最快的AI超算

黄仁勋还透露说,英伟达正在打造Eos超级计算机,并称这是“首个Hopper AI工厂”,将于数月后推出。

该超算包含18个DGX POD、576台DGX H100系统,共计4608块DGX H100 GPU,预计将提供18.4Exaflops的AI算力,这比目前运行速度最快的日本富岳超级计算机快4倍。在传统科学计算方面,Eos预计可提供275 Petaflops的性能。

|

2022-03-23 16:24:00

2022-03-23 16:24:00

2022-03-23 16:24:00

2022-03-23 16:24:00